# 大模型项目量化指标怎么写?延迟、成本、准确率,没有指标的项目也能写出数据

上一篇讲了10个典型难点怎么挖,知识星球 (opens new window)里有录友马上问:"难点我会写了,但里面的数字从哪来?我的项目根本没测过这些指标啊。"

这是简历系列里被问得最多的问题之一:我的项目没有指标怎么办?

说实话,不是你的项目没有指标,是你不知道该测什么、怎么测。大模型项目天然有大量可量化的维度——检索准不准、生成快不快、成本高不高、幻觉多不多——你只是没有把这些数字记下来。

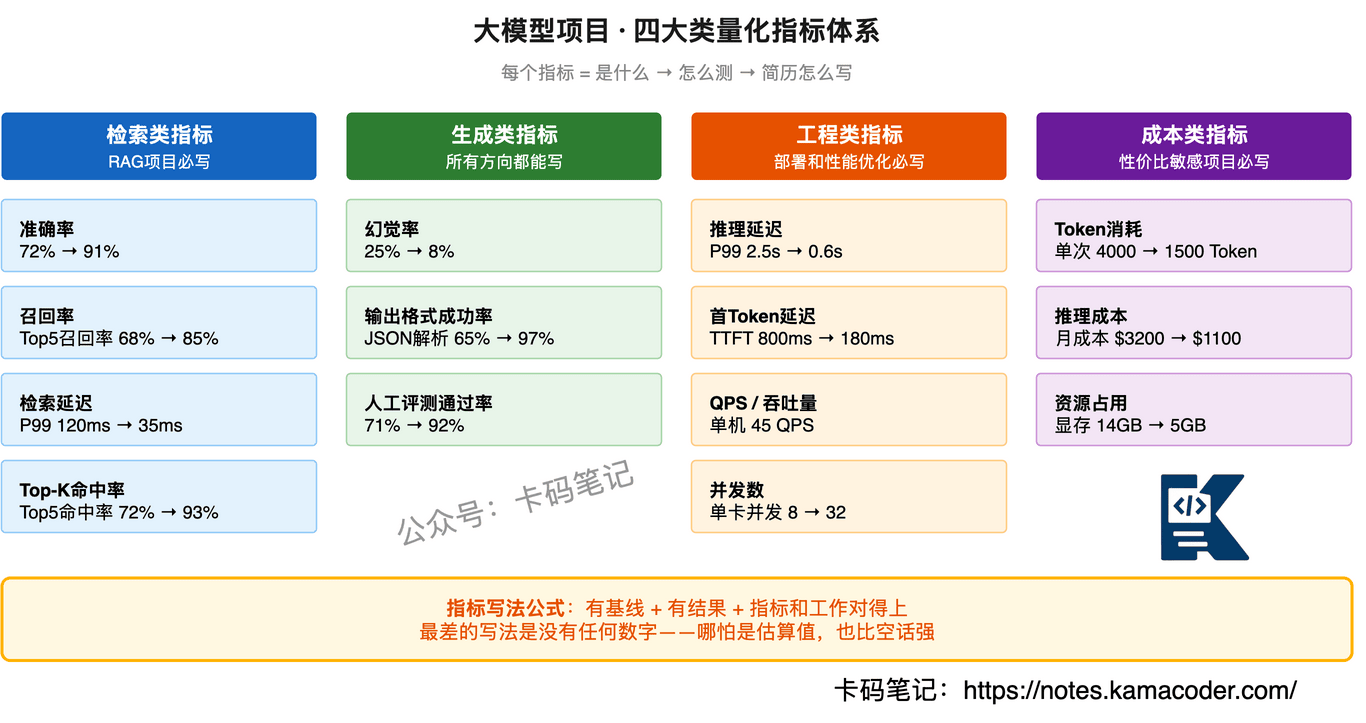

今天按四大类逐个讲:每个指标是什么、怎么测、简历上怎么写。

先看一张指标分类体系图:

# 一、检索类指标(RAG项目必写)

检索类指标是RAG项目的核心。如果你做的是RAG方向,至少要写2-3个检索指标。面试官追问检索指标的套路,可以看RAG大厂面试题汇总 (opens new window)。

# 准确率(Precision)

是什么:检索返回的结果里,有多少是真正相关的。返回10条结果,8条相关,准确率80%。

怎么测:准备一批测试问题,人工标注每个问题的正确答案来源文档,跑检索后对比。

简历写法

设计向量+BM25混合检索策略,准确率从72%提升至91%

# 召回率(Recall)

是什么:所有相关的文档里,有多少被检索到了。总共有10篇相关文档,检索到了7篇,召回率70%。

怎么测:同上,需要标注完整的相关文档集合。

简历写法

引入Reranker重排序,Top5召回率从68%提升至85%

# 检索延迟

是什么:从发起检索到返回结果的耗时。

怎么测:压测工具(wrk/locust)打请求,统计P50/P95/P99。

简历写法

优化向量索引(HNSW参数调优+预热),检索P99延迟从120ms降至35ms

# Top-K命中率

是什么:正确答案是否出现在检索返回的前K条结果中。Top5命中率85%意味着85%的问题,正确答案在前5条结果里。

简历写法

混合检索+Rerank后,Top5命中率从72%提升至93%

# 二、生成类指标(所有大模型项目都能写)

# 幻觉率

是什么:模型生成的内容中,有多少是编造的、与事实不符的。

怎么测:抽样100-200条生成结果,人工判断是否存在事实性错误。或者用GPT-4做自动评测(让GPT-4对比生成内容和参考文档,判断是否存在幻觉)。

简历写法

封装动态Prompt模板+引入RAG约束+输出自校验,幻觉率从25%降至8%

# 输出格式成功率

是什么:要求模型输出JSON/特定格式时,实际输出能被正确解析的比例。

怎么测:跑一批请求,统计JSON解析成功率。

简历写法

引入结构化Prompt约束+输出校验+失败重试,JSON解析成功率从65%提升至97%

# 人工评测通过率

是什么:人工评估生成结果的质量,判断"可用/不可用"的通过率。

怎么测:抽样让业务方或标注员打分,统计通过率。

简历写法

优化Prompt策略后,人工评测通过率从71%提升至92%

这个指标特别适合没有精确自动化指标的项目——人工评测谁都能做,成本低、说服力强。

# 三、工程类指标(部署和性能优化必写)

# 推理延迟

是什么:模型从接收输入到返回完整输出的耗时。通常关注P99(99%的请求在这个时间内完成)。

怎么测:压测工具打请求,统计延迟分布。

简历写法

采用vLLM部署+KV Cache优化+INT8量化,推理P99延迟从2.5s降至0.6s

# 首Token延迟(TTFT)

是什么:流式输出场景下,用户看到第一个字的等待时间。这个指标直接影响用户体感。

简历写法

引入流式输出+预填充优化,首Token延迟从800ms降至180ms

# QPS / 吞吐量

是什么:系统每秒能处理多少请求。

简历写法

单机部署支持45 QPS,满足日均10万次请求的业务需求

# 并发数

是什么:系统同时能处理多少个请求。

简历写法

通过请求队列+动态批处理,单卡并发从8提升至32

# 四、成本类指标(性价比敏感的项目必写)

# Token消耗

是什么:单次请求平均消耗多少Token。直接决定API调用成本。

简历写法

通过Prompt压缩+检索结果精简,单次请求Token从4000降至1500,月成本降低65%

# 推理成本

是什么:单次推理的计算成本,或者月度总成本。

简历写法

引入语义缓存(相似问题命中率40%)+短文本走小模型分流,月推理成本从$3200降至$1100

# 资源占用

是什么:模型部署需要多少GPU显存、多少台机器。

简历写法

通过INT4量化将7B模型显存占用从14GB降至5GB,单张A10即可部署

# "我的项目真的没有指标"怎么办

如果你的项目确实没有测过任何指标,有三个补救方法:

方法1:现在补测

项目代码还在的话,花半天时间跑一轮测试。准备50-100个测试问题,跑一遍检索和生成,统计准确率、召回率、延迟。这些数据就是你的指标。

方法2:用估算值

没有精确数据,给一个合理的估算值。"检索延迟降低约60%"比"优化了检索速度"强100倍。但要注意:估算值要合理,别写"准确率从10%提升至99%"这种离谱的数字。

方法3:用相对提升代替绝对值

不知道绝对值,但知道优化前后的对比?那就写相对提升。"幻觉率降低40%""延迟降低60%""成本降低65%"——相对值一样有说服力。

最差的写法是没有任何数字。 "优化了检索效果""提升了系统性能""降低了成本"——面试官看完不知道你做的有没有用、提升了多少。哪怕是估算值,也比空话强。

# 指标写法的3个常见坑

1、只有结果没有基线

"准确率91%"——从多少提升到91%的?如果原来就是90%,那你只提升了1个百分点;如果原来是60%,那你提升了31个百分点。有基线有结果,面试官才能判断你的工作价值。

2、指标和工作不匹配

个人工作写的是"优化了Chunk切分策略",指标写的是"推理延迟降低50%"——Chunk切分影响的是检索质量,不是推理延迟。指标要和你做的事情对得上。

3、数字太完美

"准确率从50%提升至99%""延迟从5s降至10ms"——这种数字面试官一看就知道是编的。真实项目的优化效果通常是"从72%到91%""从2.5s到0.6s"这种不那么整的数字。真实的数字比漂亮的数字更有说服力。

# 一张表速查

| 指标类别 | 适用方向 | 常用指标 | 简历写法示例 |

|---|---|---|---|

| 检索类 | RAG | 准确率、召回率、Top-K命中率、检索延迟 | 准确率从72%提升至91% |

| 生成类 | 所有 | 幻觉率、格式成功率、人工评测通过率 | 幻觉率从25%降至8% |

| 工程类 | 部署/优化 | 推理延迟、首Token延迟、QPS、并发数 | P99延迟从2.5s降至0.6s |

| 成本类 | 性价比敏感 | Token消耗、月成本、显存占用 | 月成本降低65% |

量化指标是简历的骨架。 没有指标的项目经历,面试官看完不知道你做的有没有用。有了指标,每一条个人工作、每一个项目难点,都变得可信、可追问、可验证。

下一篇开始真实简历点评——校招大模型简历,问题出在哪里。

评论

验证登录状态...