# 真实简历点评:校招大模型简历,问题出在哪里?

今天点评一份典型的校招大模型简历。

这份简历的问题,我在知识星球 (opens new window)里至少见过50次——不是个例,是通病。看完这篇,对照自己的简历查一遍。

先看原始简历,再逐条拆问题,最后给修改版。

# 原始简历

技能栏

- 熟悉Python、Java

- 熟悉LangChain、LlamaIndex框架

- 熟悉MySQL、Redis

- 了解Docker、Linux

- 了解机器学习基本算法

项目一:基于RAG的智能问答系统

- 使用LangChain搭建RAG流程

- 使用Milvus作为向量数据库

- 调用OpenAI API实现问答功能

- 实现了文档上传和解析功能

- 支持多轮对话

项目二:基于BERT的文本分类

- 使用BERT模型进行微调

- 在IMDB数据集上达到93%准确率

- 使用PyTorch实现训练流程

# 逐条拆问题

# 技能栏:5个问题

问题1:没有方向感

"熟悉Python、Java""熟悉MySQL、Redis"——这是后端开发的技能栏,不是大模型方向的。你投的是大模型岗位,技能栏要体现大模型相关能力。

问题2:框架堆砌

"熟悉LangChain、LlamaIndex框架"——熟悉到什么程度?用过默认pipeline还是深入定制过?光写框架名,面试官不知道你的水平。

问题3:没有分层

技能栏应该有层次——哪些是"熟悉"(深入用过、能讲原理),哪些是"了解"(用过、知道概念)。现在全混在一起,看不出重点。

问题4:缺少大模型核心技能

RAG、Agent、Prompt Engineering、向量检索、微调——这些大模型方向的核心技能一个都没写。

问题5:"了解机器学习基本算法"没有价值

这句话等于没说。什么算法?了解到什么程度?如果只是上过课,不如不写。

# 项目一:RAG项目——教程复读

问题1:项目描述太泛

"基于RAG的智能问答系统"——面向谁?什么场景?多大规模?跟网上教程跑出来的Demo有什么区别?面试官看不出来。

问题2:全是操作步骤,没有技术决策

"使用LangChain搭建RAG流程""使用Milvus作为向量数据库""调用OpenAI API"——这些是操作步骤,不是个人工作。面试官想看的是:你做了什么决策?为什么选Milvus不选Chroma?检索策略怎么设计的?效果怎么样?

问题3:没有任何量化指标

5条个人工作,没有一个数字。准确率多少?延迟多少?幻觉率多少?没有指标,面试官不知道你做的有没有用。

问题4:没有项目难点

做RAG项目不可能没踩过坑——检索不准、幻觉严重、Chunk切分不合理——这些你遇到过吗?怎么解决的?不写难点,面试官会觉得你只是跑了个Demo。

问题5:没有个人收获

项目做完了,你学到了什么?能力提升了什么?不写收获,这个项目在简历上就是一个孤立的条目,没有成长感。

问题6:"支持多轮对话"是废话

多轮对话是调API的默认功能,写出来等于没写。

# 项目二:BERT文本分类——方向不对

问题1:和大模型应用开发关系不大

BERT文本分类是NLP基础任务,不是大模型应用开发。如果你投的是大模型应用岗,这个项目的相关性很低。

问题2:太学术

"在IMDB数据集上达到93%准确率"——这是学术论文的写法。简历要写的是你解决了什么工程问题,不是你在公开数据集上跑了多少分。

问题3:没有工程化

只有训练,没有部署、没有优化、没有实际应用场景。面试官会觉得这就是一个课程作业。

# 修改后的简历

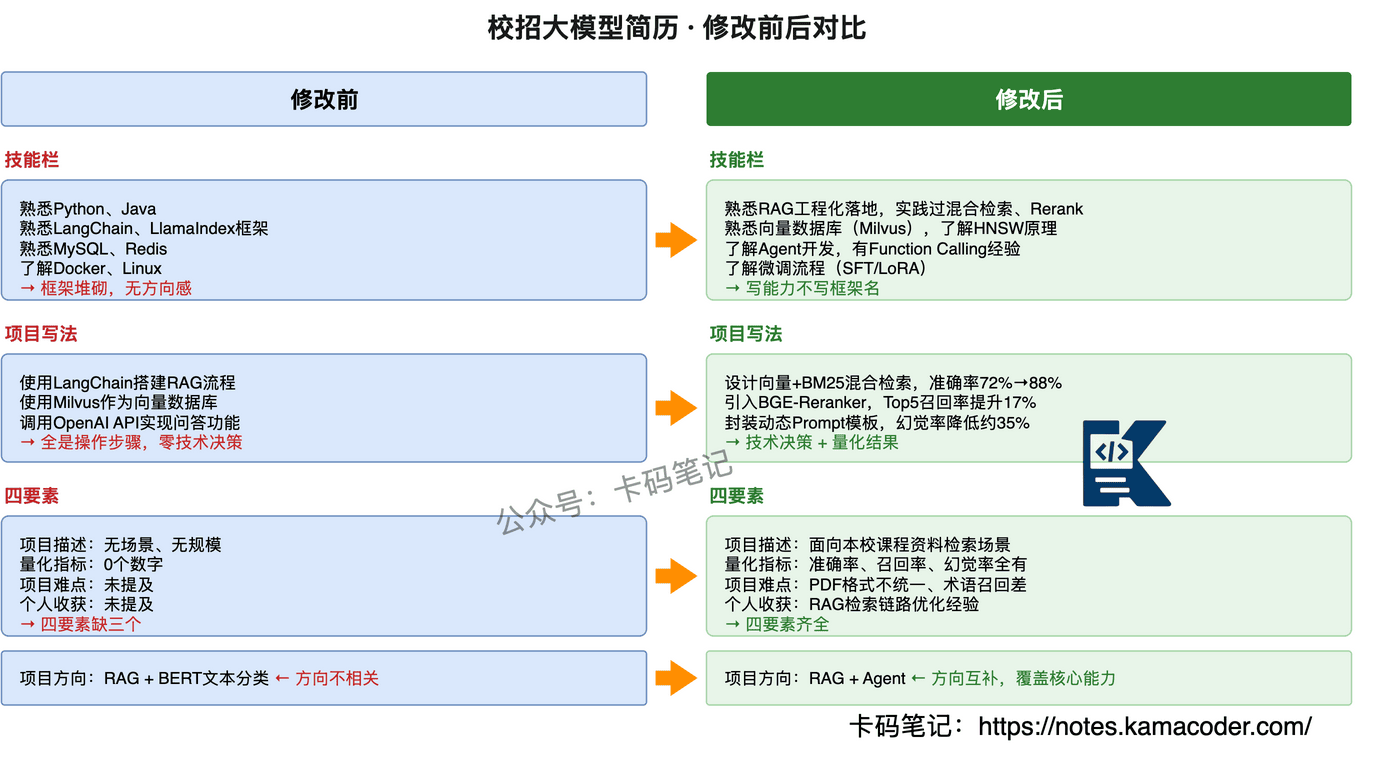

先看修改前后对比图:

技能栏

- 熟悉Python开发,有FastAPI/Flask Web服务开发经验

- 熟悉RAG工程化落地,实践过混合检索(向量+BM25)、Rerank重排序与Prompt优化

- 熟悉向量数据库(Milvus),了解HNSW索引原理与参数调优

- 了解Agent开发流程,有Function Calling工具编排经验

- 了解大模型微调流程(SFT/LoRA),理解微调与RAG的选型边界

改了什么:去掉了和大模型无关的泛泛描述(MySQL/Redis/Docker),换成大模型方向的核心技能,每条都写了具体能力而不是框架名。

项目一:基于RAG架构的课程知识库问答系统(课程项目,独立扩展)

面向本校计算机专业课程资料检索场景,支持PDF/Markdown文档解析、语义检索与智能问答

个人工作:

- 课程要求搭建基础RAG流程,在此基础上独立扩展:设计向量+BM25混合检索策略,准确率从72%提升至88%

- 引入BGE-Reranker重排序,Top5召回率提升17%

- 设计递归切分+overlap策略,针对PDF课件的标题/段落结构优化切分逻辑,解析准确率从70%提升至91%

- 封装动态Prompt模板,引入检索结果相关性过滤,幻觉率降低约35%

项目难点:

- 课件PDF格式不统一(有扫描版、有文字版、有混合版),通过OCR+文字提取双通道解析,覆盖率从60%提升至95%

- 向量检索对专业术语召回差(如"B+树""哈希冲突"),引入BM25关键词检索补充,专业术语召回率提升30%

个人收获:

- 深入理解RAG检索链路优化,积累了混合检索与Rerank的工程经验

改了什么:

- 项目描述加了场景("本校计算机专业课程资料")和定位("课程项目,独立扩展")

- 个人工作从操作步骤改成了技术决策+量化结果

- 补了项目难点——PDF格式不统一、专业术语召回差,都是真实会遇到的问题

- 补了个人收获

项目二:基于Agent架构的智能学习助手(个人项目)

面向编程学习场景,支持代码解释、错误诊断与学习路径推荐

个人工作:

- 设计3类Function Calling工具(代码分析/错误诊断/资料推荐),工具调用成功率92%

- 实现ReAct推理循环+错误恢复机制,工具调用失败后自动重试,任务完成率从65%提升至85%

- 设计结构化Prompt约束输出格式,JSON解析成功率从70%提升至96%

项目难点:

- 工具调用偶发参数格式错误,引入Schema校验+自动修复机制

- 多轮对话中上下文丢失导致推荐偏移,通过关键信息摘要稳定Agent行为

个人收获:

- 积累了Agent工具编排与错误恢复的工程经验

改了什么:把BERT文本分类换成了Agent项目——和大模型应用开发直接相关,而且能体现工程化能力。如果你确实没做过Agent项目,花一周时间做一个,比在简历上写一个不相关的BERT项目强100倍。

# 这份简历改完,核心变化是什么

- 技能栏从"框架清单"变成了"能力描述"——面试官一眼知道你会什么、到什么程度

- 项目从"操作步骤"变成了"技术决策+量化结果"——每条都能经住追问

- 补了难点和收获——四要素齐全,信息量翻倍

- 两个项目方向互补——一个RAG一个Agent,覆盖大模型应用开发最核心的两个方向

简历写好了只是第一步,面试还要准备。RAG方向的面试追问看RAG大厂面试题汇总,Agent方向看Agent大厂面试题汇总。

校招简历最核心的问题不是项目不够大,是写法太浅。 同样的项目,换一种写法,信息量差3倍。

评论

验证登录状态...